文章图片

文章图片

文章图片

文章图片

文章图片

文章图片

文章图片

文章图片

文章图片

文章图片

文章图片

文章图片

文章图片

当地时间10月9日 , 处理器大厂AMD 在美国旧金山举行的 Advancing AI 活动期间 , 正式发布了最新的 Instinct MI325X AI GPU 加速器 , 该加速器配备 256 GB HBM3e 内存 , 而明年的 MI355X 则将配备 288 GB HBM内存 。

在介绍MI325X之前 , AMD介绍了整个 Instinct 平台的成绩 , 该平台已获得世界顶级 AI 公司的支持 , 并被 Meta、OpenAI 和 Microsoft 等一些头部品牌厂商采用 。

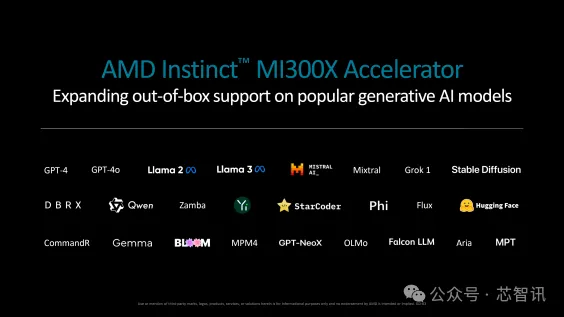

据称 AMD 的 MI300X 在一系列特定于 AI 的工作负载中比 NVIDIA H100 的性能提高了 30% 。 AMD 在其 ROCm 套件中增加的工作有助于从旗舰加速器中获得更多性能 , 但现在是时候构建具有相同强大软件支持的更好硬件了 。

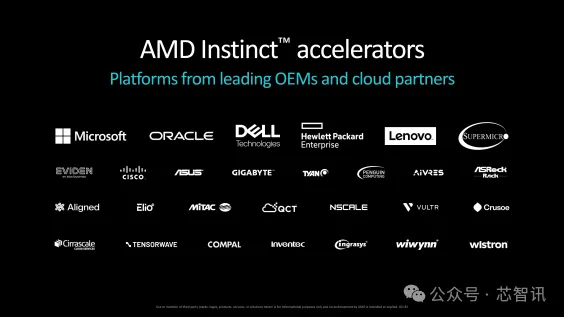

AMD表示 , 其致力于性能领先、轻松迁移、开放式生态系统和以客户为中心的产品组合 , 这为领先的 OEM 和云合作伙伴提供了大力支持 。 因此 , 随着行业中的 AI 需求增长到无与伦比的高度 , AMD加快了其下一代解决方案的推出 。

AMD MI325X:256 GB HBM3e和CDNA 3架构 , 1530 亿个晶体管

全新的MI325X加速器建立在与 MI300X 相同的基本设计和架构之上 , 使用了 CDNA 3 GPU 架构 , MI325X 可以看作是中期升级 , 提供 256 GB 的 HBM3e 内存 , 基于 16-Hi 堆栈制成 , 内存带宽高达 6 TB/s , FP8性能达2.6 PFLOP , FP16 性能为 1.3 PFLOP 。 所有这些都封装在一个芯片中 , 总共拥有1530 亿个晶体管 。

AMD 预计 Instinct MI325X AI GPU 将于 2024 年第四季度开始首批生产 , 并从 2025 年第一季度开始通过领先的合作伙伴提供相应的服务器解决方案 。

全新的基于MI325X的AI Instinct 服务器将具有多达 8 个 MI325X 配置 , 具有高达 2 TB 的 HBM3e 内存、896 GB/s 的无限结构带宽、48 TB/s 的内存带宽、20.8 PFLOPs 的 FP8 和 10.4 PFLOPs 的 FP16 性能 。 每个 GPU 也配置为 1000W , 这比 MI300X 的 750-700W 配置有了很大的提升 。

AMD 声称 Instinct MI325X AI GPU 加速器在 Mixtral 8x7B 中应该比 NVIDIA H200 快 40% , 在 Mistral 7B 中快 30% , 在 Meta Llama 3.1 70B LLM 中快 20% 。

与 Llama 3.1 405B 中的 H200 HGX AI 平台相比 , 8x MI325X 平台的性能也将提高 40% , 在 70B 推理测试中的性能提高 20% 。 在 AI 训练方面 , 8x MI325X平台将提供与 8x H200 平台相似或 10% 的性能提升 。

AMD MI355X:3nm制程 , 配备288 GB HBM3e和CDNA 4架构

明年 , AMD 还计划推出全新的 Instinct MI355X GPU 加速器 , 该加速器将针对 AI 工作负载 , 该加速器将使用 3nm 工艺节点构建 。 GPU 将采用 CDNA 4 架构 。 在规格方面 , 内存将升级到更高的容量 , 最高可达 288 GB HBM3e , 同时支持 FP4/FP6 数据类型 。

AMD 表示 , CDNA 4 架构的性能比 CDNA 3 高出 35 倍 , AI 计算增加了 7 倍 , 内存容量/带宽增加了 50% , 并且还配备了最新的网络效率进步 。

在性能方面 , AMD Instinct MI355X AI GPU 将提供高达 2.3 PFLOP 的 FP16 性能 , 比 MI325X 高 80% , 而 FP8 数据也比 MI325X 高 80% , 达到 4.6 PFLOPS 。 新的 FP6 和 FP4 计算性能额定为 9.2 PFLOPS 。

MI355X 的内存容量和内存带宽将增加 50% , 速度比当前一代 MI300X 高出 8 TB/s 。

首款采用八个MI355X GPU的平台将于2025年下半年上市 , 并提供高达2.3 TB的HBM3E内存容量和64 TB/s带宽、18.5 PFLOPs的FP16、37 PFLOPs的FP8和74 PFLOPs的FP6/FP4计算 。

ROCm 6.2 继续为 Instinct 提升 AI 性能

回到软件方面 , AMD 宣布推出其最新的 ROCm 6.2 生态系统 , 该生态系统在推理中的一系列 AI 工作负载中实现了 2.4 倍和 2.8 倍的平均性能提升 , 训练性能平均提高了 2.4 倍 。

最后 , AMD 仍在确认其 Instinct MI400 , 该芯片于 2026 年作为“CDNA Next”部分发布 , 但没有使用最近披露的 UDNA 架构名称 。 也许现在使用 UDNA 命名还为时过早 。

【1530亿晶体管!AMD MI325X发布:比英伟达H200快40%!】话虽如此 , AMD 似乎将通过未来的 Instinct 产品全力以赴 , 与 NVIDIA 等公司展开激烈竞争 , 并与一直在努力赶上其他公司的英特尔展开竞争 。

编译:芯智讯-浪客剑 来源:wccftech

推荐阅读

- AMD新主板使用不完全指南,9700X+X870E暗黑 多方位评测分享

- 商用AI“芯”动力!AMD锐龙AI PRO 300移动处理器正式发布

- 神雲科技用最新AMD企业级技术方案 为数据中心提供卓越性能和密度

- AMD处理器9700X、7600X3D、7800X3D游戏性能对比

- AMD将推RX 7650 GRE显卡 新一代甜品神卡来袭?

- MTK旗舰芯天玑9400发布:集成291亿晶体管,喊话骁龙“不用追高频”

- 带领公司从危机走向领导者!苏姿丰发文庆祝任AMD CEO整十年

- 鲁大师2024PC Q3季报:黑神话带动装机量飙升,AMD新CPU成Q3亮点

- AMD 麻烦大了?

- AMD粉丝的福利!海外极客拆解Ryzen 5 9600X,高清CCD图曝光